El ataque militar de Estados Unidos e Israel contra Irán ha matado al líder supremo de la República Islámica, el ayatolá Alí Jamenei, y ha dado pie a la difusión de cientos de imágenes en redes sociales. En VerificaRTVE desmontamos falsedades y bulos compartidos en redes a raíz de este conflicto. Desde una foto falsa del ayatolá entre escombros hasta el bulo que presenta una imagen real de Irán como si fuera Kabul.

No es un bulo y no es Kabul: son imágenes reales de una escuela iraní

En redes acusan a RTVE, Efe y el diario El País de haber difundido un bulo por compartir como si fuera de Irán una foto que aseguran que fue tomada en Kabul en 2021. Es falso. Las imágenes son reales, están contrastadas y corresponden a la escuela de Minab, en el sur de Irán, cuya destrucción el régimen atribuye a un ataque de Israel.

Medios internacionales con equipos de verificación como las agencias The Associated Press, France Presse y Reuters han publicado vídeos y fotos que muestran la destrucción en la escuela de primaria de Minab. Dos herramientas de detección de IA confirman que las imágenes no están creadas con esta tecnología.

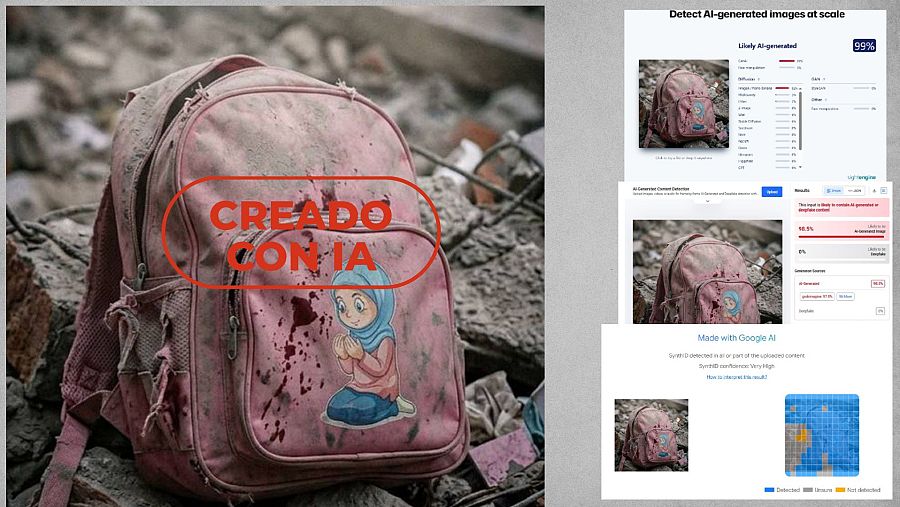

Esta imagen de una mochila de niña con sangre es falsa

Desde las redes sociales, la Embajada de Irán en Austria ha difundido en X una foto que muestra una mochila de niña con sangre y un mensaje de condena por la «devastadora tragedia» en la escuela de Minab. La imagen no es real. Es una foto falsa creada con inteligencia artificial.

Las herramientas de detección Google SynthID, Hive y Sight Engine concluyen con una probabilidad superior al 90% que esa imagen es artificial porque está creada con esta tecnología.

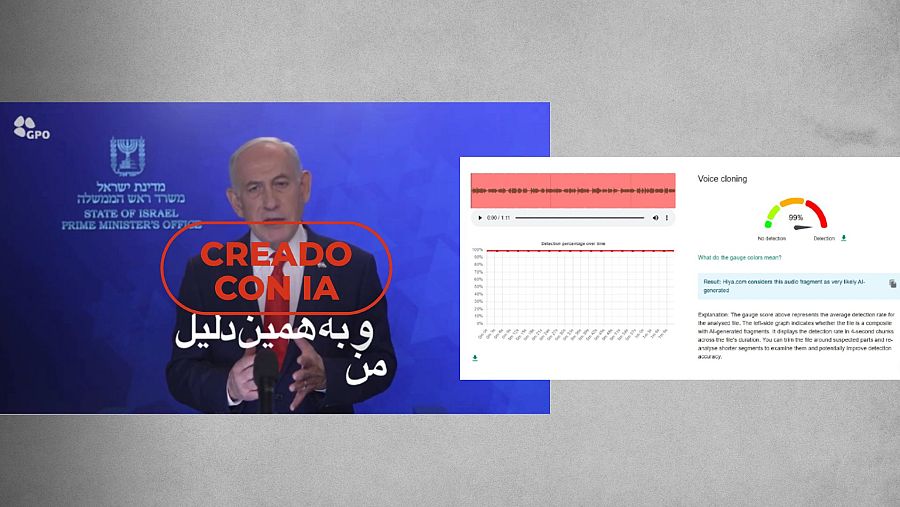

Netanyahu no habla farsi: la voz está creada inteligencia artificial

El primer ministro de Israel, Benjamin Netanyahu, ha difundido en la red social X un vídeo de 72 segundos de duración en el que aparece hablando en farsi, el idioma oficial de los iraníes. La imagen es real pero la voz está creada con inteligencia artificial. La herramienta de detección Hiya, del proyecto Invid WeVerify, concluye que la voz del vídeo está creada con inteligencia artificial. La misma conclusión alcanza la herramienta del Proyecto IVERES.

En VerificaRTVE hemos pedido a una periodista iraní que analice el audio y concluye que la voz «está generada con inteligencia artificial» porque Netanyahu «no habla farsi». Señala además que el vídeo permite ver que la voz no está sincronizada con los labios de Netanyahu. Los fallos de sincronización labial (lip sync) son habituales en vídeos que incorporan voces creadas por inteligencia artificial. El primer ministro difunde esta grabación con la voz clonada en farsi horas después de publicar el 28 de febrero este vídeo más extenso en el mismo escenario, con la misma ropa y en el que habla en hebreo con subtítulos en este idioma.

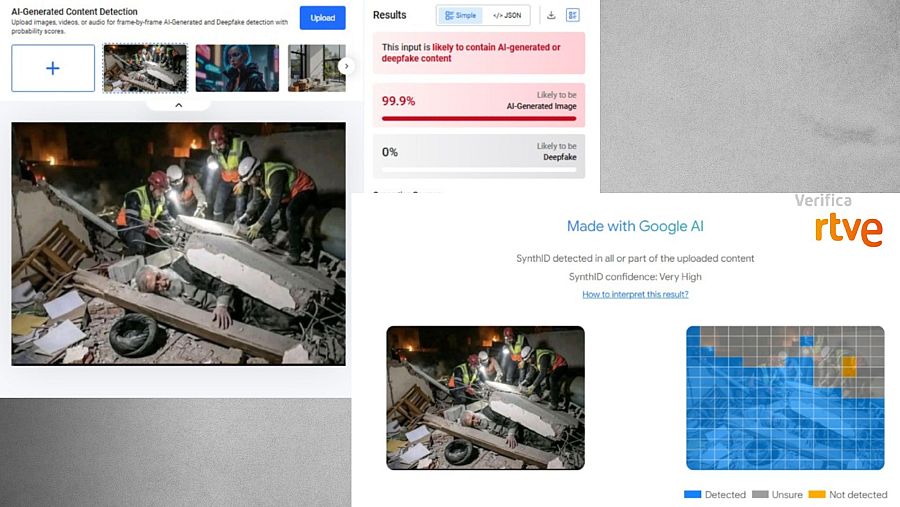

Esta foto de un ayatolá entre escombros está creada con inteligencia artificial

Mensajes de redes difunden una imagen que muestra entre escombros a un hombre con un atuendo similar al de un ayatolá y la presentan como la «primera foto» del rescate del cadáver del líder supremo de Irán, Alí Jamenei. Es un bulo. La imagen está generada con inteligencia artificial.

En VerificaRTVE hemos analizado la foto con la herramienta de detección Google SynthID y concluye que la imagen está creada con una inteligencia artificial de esta firma tecnológica. La herramienta de detección Hive aporta el mismo análisis: es una foto artificial., como puedes ver en la imagen inferior.

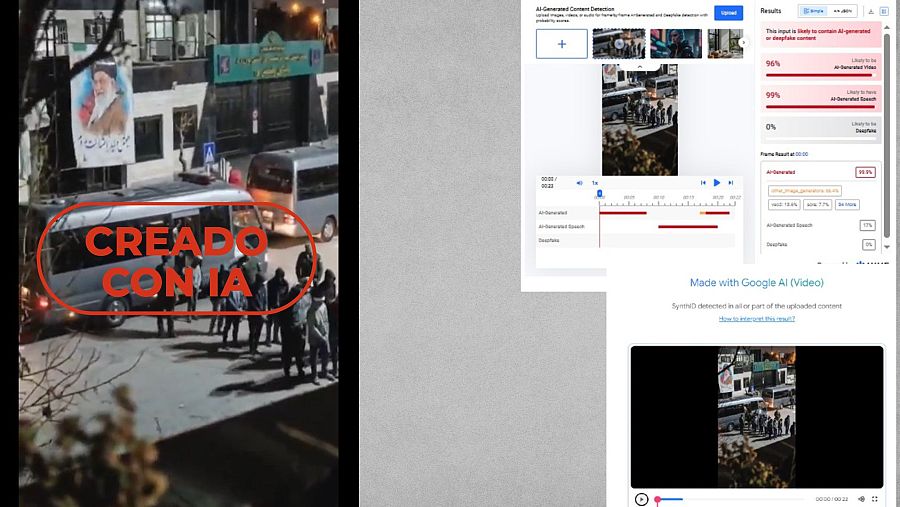

Este vídeo de presos saliendo de la cárcel iraní de Evin es falso

En canales de Telegram se ha difundido un vídeo que muestra a varios hombres saliendo de un autobús y lo presentan como si fueran presos que están siendo trasladados desde la cárcel de Evin, en Teherán, la capital de Irán. Es falso. Es un vídeo creado con inteligencia artificial.

En VerificaRTVE no hemos encontrado noticias relacionadas con la prisión de Evin en medios internacionales como la BBC, el diario The New York Times y las agencias Reuters y AFP. Tampoco hemos encontrado noticias recientes con referencias a esta prisión con una búsqueda por palabra clave en farsi en medios y páginas web de Irán.

Hemos analizado la grabación con Google SynthID y esta herramienta concluye que el vídeo está generado con inteligencia artificial de la firma tecnológica estadounidense. La herramienta de detección Hive llega a la misma conclusión: es una grabación creada con inteligencia artificial.